-

【日报】2026-06-05 明天考一门,周四考两门,下周日考一门。 今天解决了全景数据集解析问题。

2026年6月5日 -

【日报】2026-06-02 在研究auto-research。 这几天要开始复习了,也不是太有时间干活。

2026年6月2日 -

【日报】2026-06-01 服务器出问题了。消融实验还在跑。这几天横向是做不了了。 终于有空折腾全景了,攒了十多篇论文没看。 感觉在横向上投入精力有点太多了。我想之后我就蒸馏+微调个输入小点的模型就差不多了。

2026年6月1日 -

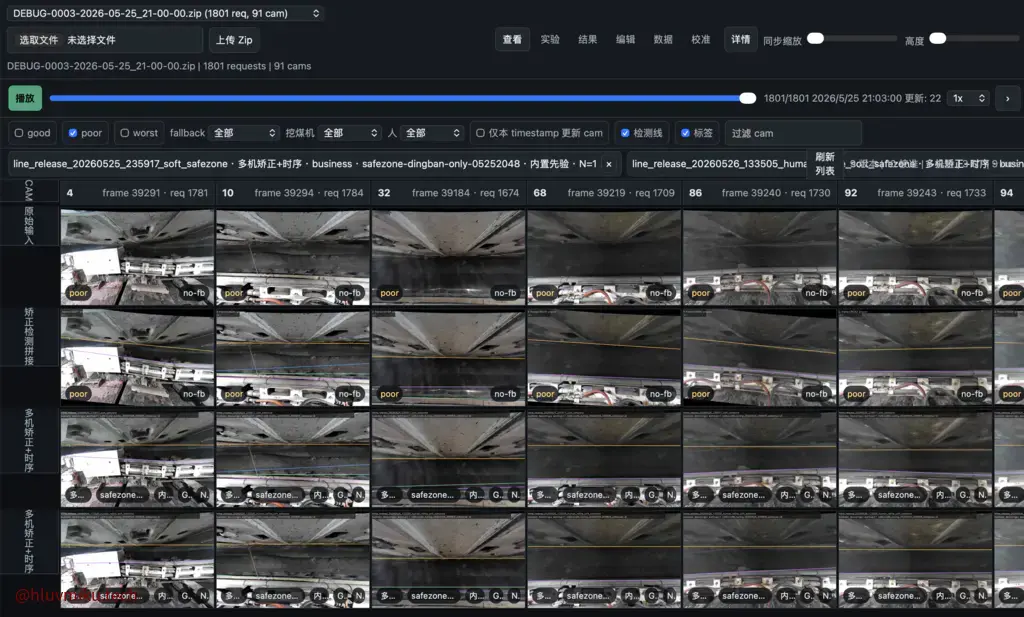

【日报】2026-05-29 这几天主要做横向,搭了个测试环境、采集数据、明确需求、训练模型、切换技术方案、蒸馏啥的,干了一堆活,都不知道怎么总结,做的太多了。还有一堆探索过的技术路线废案更是不知如何呈现。 全景数据还在爬,也还在帮师兄推进消融实验。

2026年5月29日

2026年5月29日 -

【日报】2026-05-19 开了一天会。 明天把消融实验脚本打通、爬虫代码确认,后天给横向新的predict函数+文档、完成大规模标注数据管线,周五/下周一分发代校对数据,全景相关的还有好多paper想看没时间。 事好多。

2026年5月19日